クラウドデータソースの管理

この記事では、クラウドデータソースを管理する方法について説明します。

サポートされているベンダー

クラウドデータソースの構成は、ほとんどのベンダーでほぼ同じです。ベンダー固有の構成の詳細については、以下を参照してください:

クラウドデータソースの作成

クラウドデータソースを作成するには、以下の手順を使用します:

- Sources > Data Sources に移動します。

- + Add Data Source をクリックします。

- Categories の下で Data Warehouse をクリックし、ベンダーを選択します。

- Name フィールドに、使用事例に関連するデータソースの一意の名前を入力します。

- Continue をクリックします。

接続の確立

データのインポートを構成する前に、クラウドデータソースへの接続を確立する必要があります。接続は、Tealiumをクラウドデータソースに接続するための再利用可能なベンダー資格情報の構成です。

- Connection Configuration 画面で、データソースの名前を確認し、リストから既存の接続を選択するか、+ アイコンをクリックして接続を作成します。

- 新しい接続の場合、接続情報を入力してから Save をクリックし、Connection Configuration 画面に戻ります。

- Establish Connection をクリックします。

ベンダーへの接続についての詳細は、以下を参照してください:

処理の構成

処理の有効化

Enable Processing をオンにして、変更を保存して公開した直後にデータのインポートを開始します。構成を完了する間、この構成をオフにしておき、後で処理を有効にすることもできます。

クエリ頻度

Tealiumがデータを取得する頻度を構成します。処理のための以下のオプションから選択します:

- ニアリアルタイム

プロセスは2秒ごとに実行されます。 - 時間ごと

プロセスは毎時開始時に実行されます。 - 日次

プロセスは指定した時間に1日1回実行されます。 - 週次

プロセスは指定した日と時間に1週間に1回実行されます。

バッチサイズ

以下のバッチオプションから選択します:

- デフォルト:バッチあたり1,000レコード。

- カスタム:1,000レコードを超えるカスタムバッチを作成します。

- 無制限:利用可能なすべてのデータを処理するための制限なしのバッチを作成します。

クエリの構成

Query Configuration 画面で、基本または高度な構成モードから選択します。

- 基本モード:データソース構成で指定されたデフォルトスキーマを使用してデータがインポートされます。1つのテーブルまたはビューからのみデータを処理できます。

- 高度なモード:高度なSQLエディタを使用して、複数のスキーマからの1つ以上のテーブルを結合することができます。

1. クエリの構築

基本モード

基本モードでは、クエリに含めるテーブルと列を選択します。インクリメント、タイムスタンプ、またはインクリメントとタイムスタンプの列が選択に含まれている必要があります。

オプションで、カスタム条件に一致するレコードのみをインポートするためにSQL WHERE 句を含めることができます。SQL WHERE 句はネストされた SELECT ステートメントをサポートしていません。複数のテーブルを結合するには、高度なモードを使用します。

高度なモード

高度なモードでは、SQLエディタを使用して有効な読み取り専用のSQLクエリを入力し、1つ以上のテーブルまたはスキーマに接続します。SQLエディタは CAST や JOIN などの高度なSQLコマンドをサポートしています。インクリメント、タイムスタンプ、またはインクリメントとタイムスタンプの列が選択に含まれている必要があります。

SQLクエリのベストプラクティス

- 計算フィールド

高度なSQLクエリは計算(派生)フィールドをサポートしています。計算値は各バッチフェッチで再評価され、ベンダーによっては異なる動作をする場合があります。クエリモードの列(タイムスタンプ、インクリメント、またはタイムスタンプとインクリメント)で計算フィールドを使用すると、データのインポート時にエラーが発生する可能性があります(たとえば、行のスキップや取り込みのループ)。クエリモードの列で計算フィールドを使用することはお勧めしません。 - LIMIT句

Tealiumデータソースのストリーミング性質のため、LIMIT句はインポートされるデータの総量を減らしません。テストのために処理したいレコード数を変更するには、WHERE句を使用するか、エンドツーエンドテストを使用してください。詳細については、テスト構成を参照してください。 - 読み取り専用

読み取り専用のSQLクエリのみがサポートされています。クエリがスキーマやデータを変更しないことを確認してください(たとえば、DELETE、UPDATE、INSERT、DROP、ALTERの使用)。

ステータス

クラウドデータソースを構成した後、以下のステータスのいずれかが表示される場合があります:

| ステータス | 説明 |

|---|---|

| 失敗 | 認証失敗などの接続エラーが発生し、エラーが解決されるまでインポートが停止します。インポート中の行レベルのエラーはこのステータスを引き起こさず、データソースは実行中のままでエラーが記録されます。 |

| 非アクティブ | データソースは作成されましたが、オンにされたことがなく、他のステータスに移行することもありませんでした。 |

| 初期化中 | コネクタが初めて起動するか、停止状態から再開するときです。これは実行中またはスケジュール済みに移行する前の一時的な状態です。 |

| 実行中 | コネクタはアクティブにクエリを実行し、データをインポートしています。 |

| スケジュール済み | 次のインポートがスケジュールされて実行されます。この状態は初期化中または実行中の後に続くことがあります。 |

| 停止 | データソースは以前に有効にされましたが、現在はオフになっています。有効にされるまでデータのインポートは行われません。 |

| 未割り当て | タスクはクラウドワーカーに割り当てられるのを待っています。 |

テスト構成

データソース、セグメント、またはアクティベーションを有効にする前に、データソースとクエリをテストすることをお勧めします。ただし、テストを実行すると、セグメントがアクティブになる可能性があり、有効なアクションがトリガーされたり、下流のシステムに影響を与える可能性があります。意図しない結果を防ぐために、コネクタと機能を無効にし、テストレコードを制限し、受信者と調整してください。

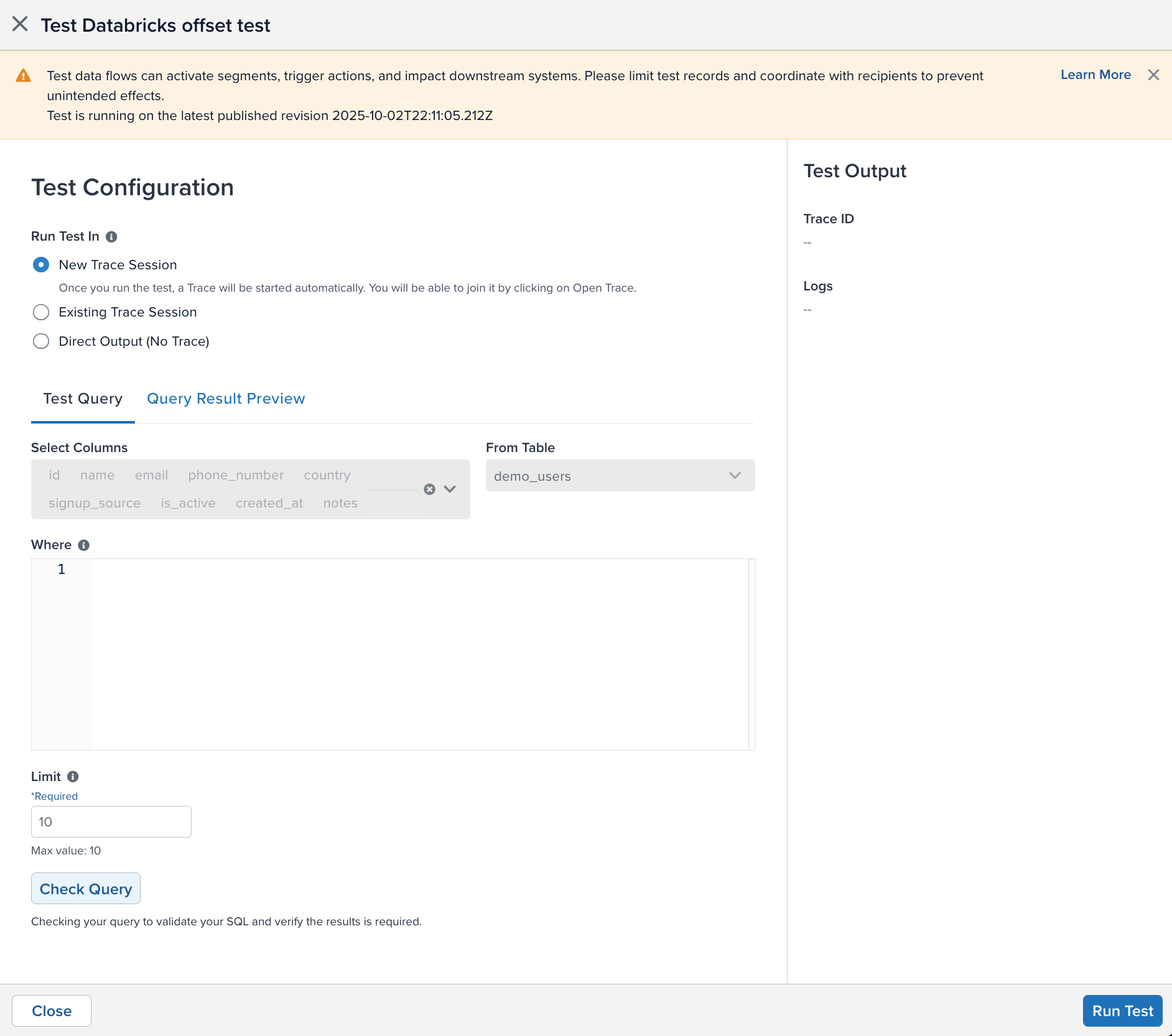

データソース構成をテストするには、次の手順を使用します:

- データソース画面でデータソースを見つけ、編集アイコンをクリックします。

- データソースウィンドウの右上隅にあるアクションボタンをクリックし、エンドツーエンドテストをクリックします。

- 出力を受け取りたい方法を選択します:

- 新しいトレースセッション:出力は最大10レコードの新しいトレースセッションで表示されます。このオプションは、エンドツーエンドの検証とログの詳細を確認するのに最適です。

- 既存のトレースセッション:出力はすでに開始したトレースセッションで表示されます。トレースIDを入力し、トレースに参加をクリックします。

- ダイレクト出力:出力の生の結果が画面に表示されます。データレコードにトレースIDは追加されず、トレースは利用できません。このオプションは、クエリと属性マッピングをすばやく確認するのに最適です。

- テストのために処理する行数を選択します。最大行数は10です。

- テストクエリの下で、テストに含めるテーブルの列を選択します。列をリストから削除するには、列のXをクリックします。少なくとも1つの列を選択する必要があります。

- From Tableの下で、クエリを実行するテーブルを選択します。Select Columnsボックスは、テーブルの列で更新されます。

- Whereの下で、テーブルに対して実行するSQLクエリを入力します。

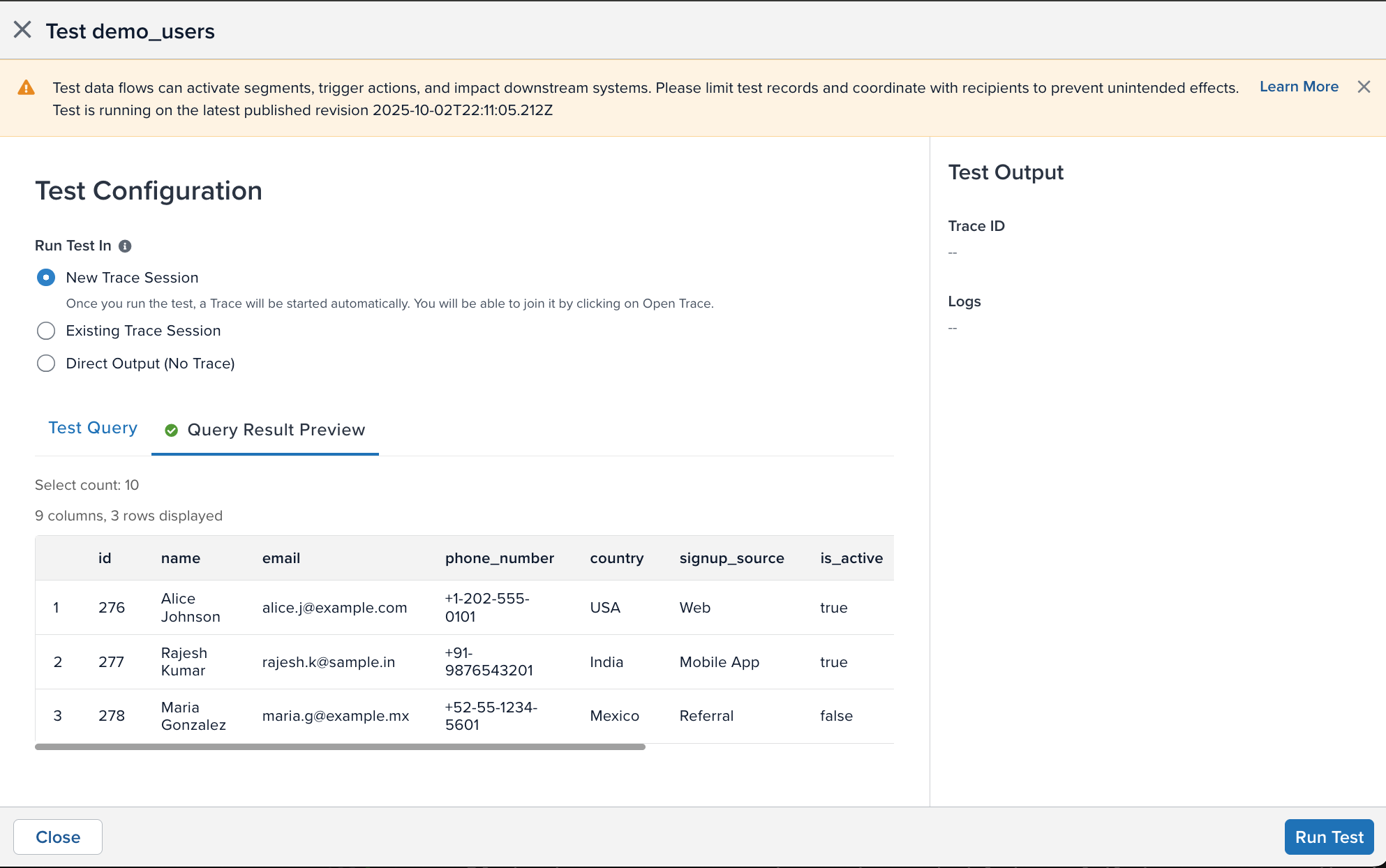

- Check QueryをクリックしてSQLを検証し、必要なフィールドが構成されていることを確認します。

- 結果はQuery Result Previewタブの下のテーブルに表示されます:

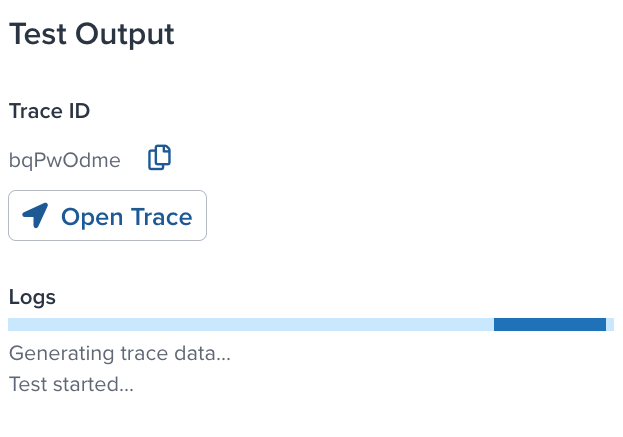

- Start Testをクリックして構成テストを開始します。

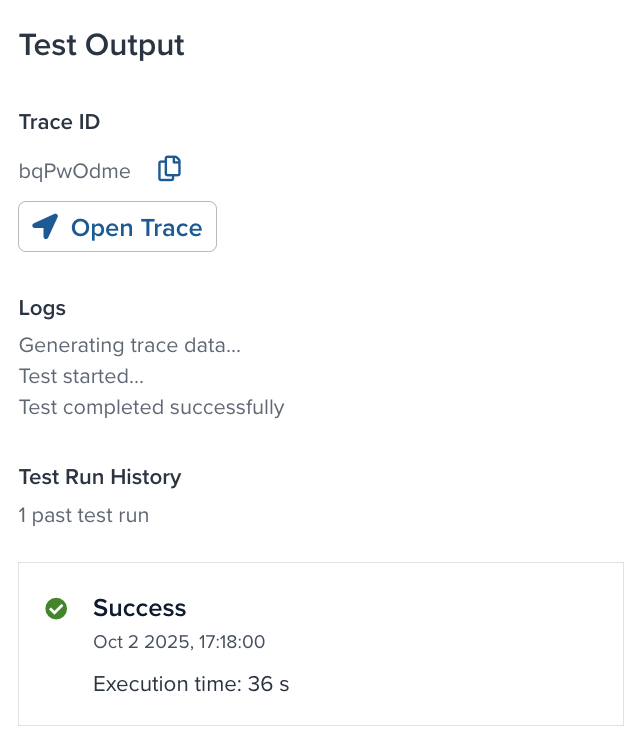

右サイドバーには、テストの完了までの時間を見積もるプログレスバーと、テストがエラーに遭遇した場合に知らせるステータスメッセージが表示されます。

テストが完了すると、結果が表示されます。

- テストの実行をトレースで見たい場合は、Join Traceをクリックします。

- テストが失敗した場合、次のことができます:

- Edit Test Configurationをクリックして構成を変更します。

- Retry Testをクリックして現在の構成を再実行します。

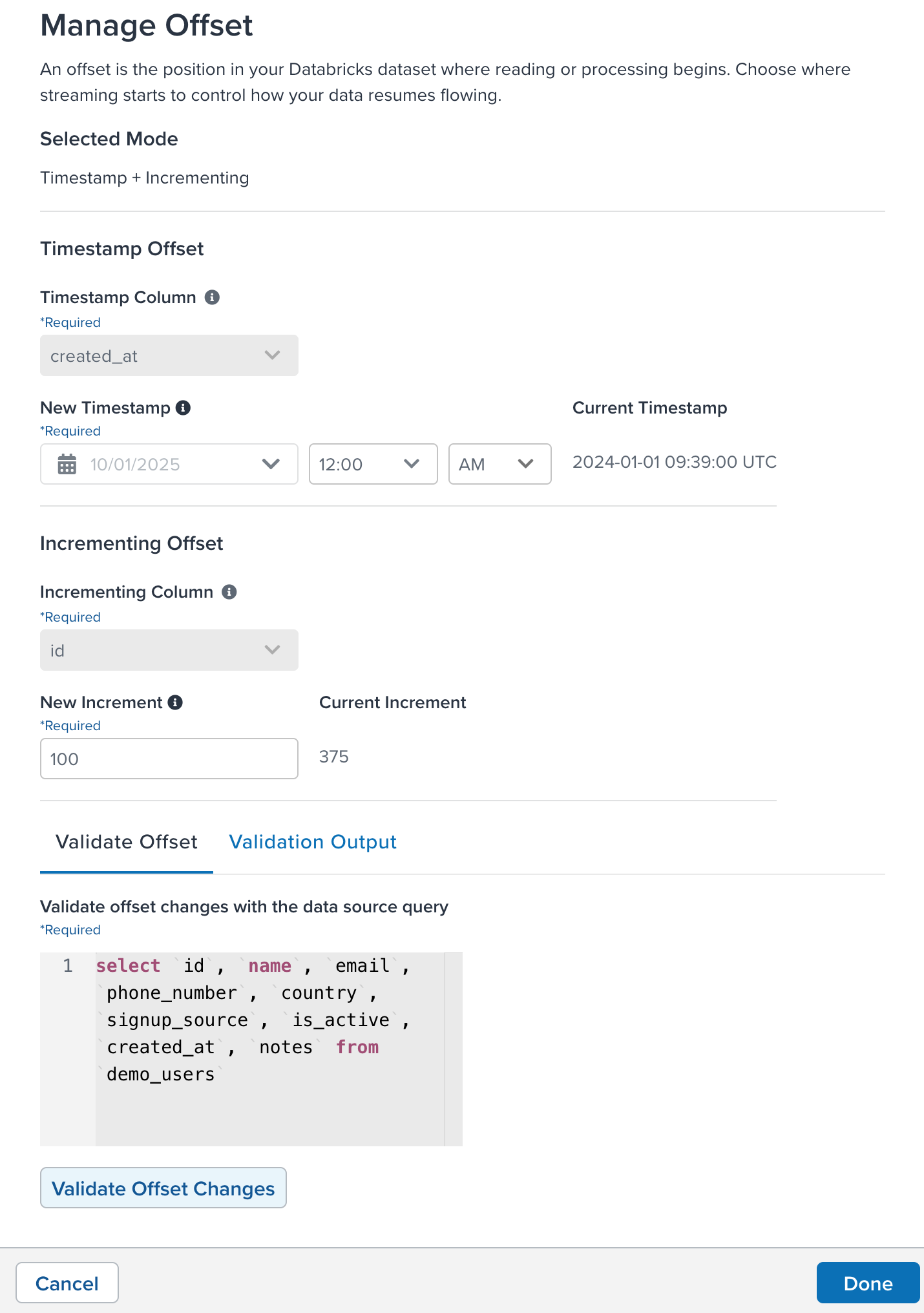

処理開始の構成

データソースは、クエリが開始される日付または増分値の位置を追跡します。この位置をリセットまたは手動で構成して、ビューまたはテーブルのどこからクエリを開始するかを制御できます。

たとえば、最近のメーリングリストのアクティベーションにエラーが含まれており、100レコードが処理され、現在の増分位置が342であるとします。メールアクティベーションを修正した後、これらのレコードを再処理するには、開始点を242に構成します。データソースを再起動すると、その位置からレコードのクエリが開始され、修正されたメールが送信されます。

次の条件が真実である場合にのみ、開始点を管理できます:

- 現在のプロファイルが公開されています。

- クエリモードがタイムスタンプ + 増分(推奨)、タイムスタンプ、または増分です。完全な再同期クエリモードでは、開始点を管理することはできません。

- データソースが停止しています。

- データソースのステータスが実行中、スケジュール済み、または失敗している場合、開始点を編集することはできません。現在の開始点に関する情報のみが利用可能です。

- ステータスが初期化中、非アクティブ、または接続エラーがある場合、開始点は利用できません。

データソースの開始点を管理するには、次の手順を使用します:

- Data Sources画面でデータソースを見つけ、編集アイコンをクリックします。

- データソースの詳細ウィンドウの右上隅にあるアクションボタンをクリックし、Set Processing Startをクリックします。

- 利用可能な開始点の方法はProcessing Start TimestampとIncrementing Start Pointです。クエリモードによって利用可能な開始点が決まります。

- Timestamp Columnの下で、タイムスタンプを表すテーブルの列を選択します。

- New Timestampの下で、データのインポート時に使用する開始位置として日付と時間を選択します。

- 新しいタイムスタンプは過去の日時でなければなりません。未来の日時は使用できません。

- 現在のタイムスタンプフィールドは、現在使用されている開始位置を表示します。

- Incrementing columnの下で、テーブルに追加される各行の増分値を表す列を選択します。

- New Incrementの下で、データのインポート時に開始点を構成するために使用する数値を入力します。

- 新しい開始点は正の整数でなければなりません。

- 現在の開始点フィールドは、開始点として使用する現在使用されている開始位置を表示します。

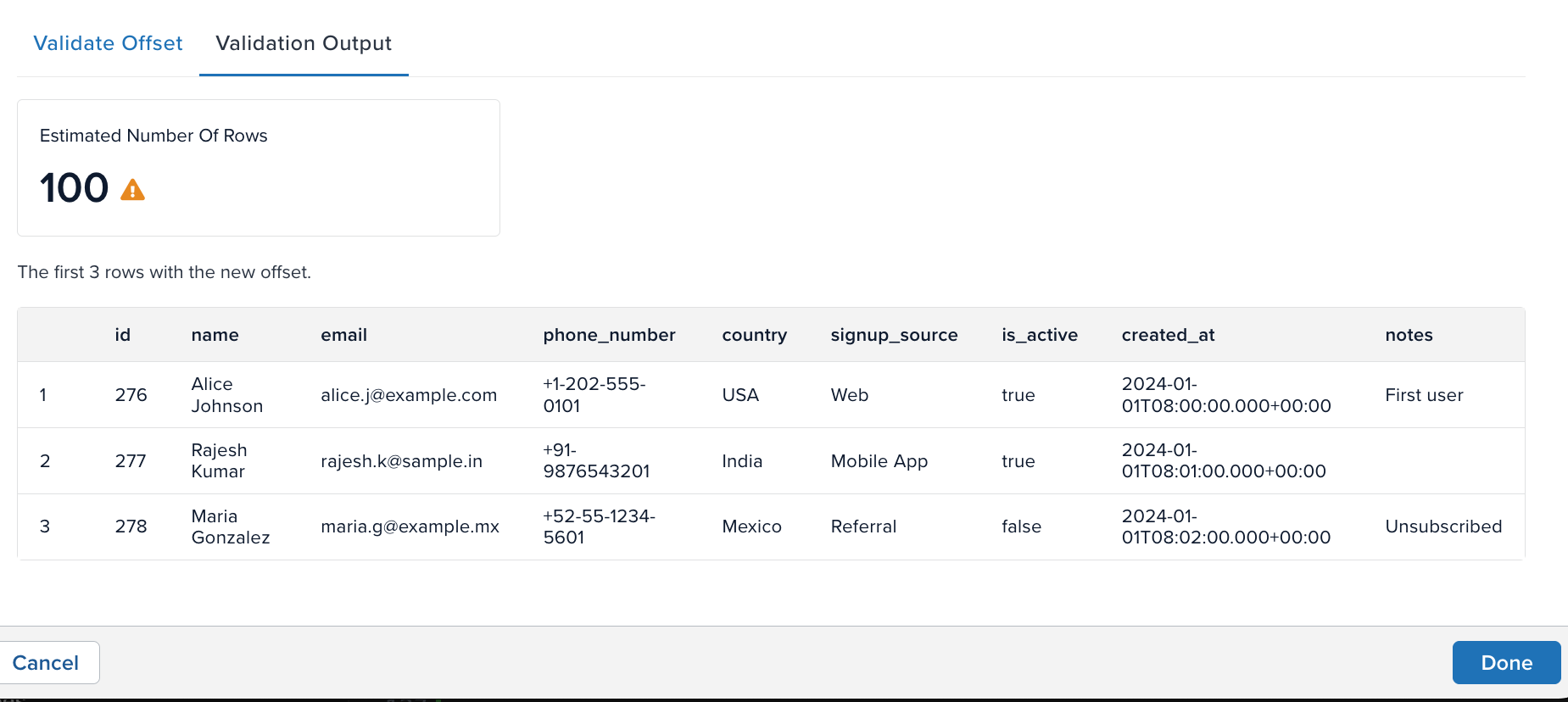

Validate Processing Start Changesをクリックして、新しい開始点からインポートされるデータのプレビューを表示します。テーブルはサンプル行を表示し、開始点を調整した後に処理される行数の見積もりも提供します。

Doneをクリックして新しい開始点の構成を確認します。Cancelをクリックして変更を破棄します。 開始点を変更した後、データソースを再起動します。

最終更新日 :: 2026年May月12日